Review of Deep Learning Applications in Spinal Image Segmentation

Received date: 2023-04-25

Online published: 2024-03-13

Copyright

Deep learning algorithms have the advantages of strong learning, strong adaptive, and unique nonlinear mapping abilities in spinal image segmentation. Compared with traditional segmentation methods, they can better extract key information from spinal images and suppress irrelevant information, which can assist doctors in accurately locating focal areas and realizing accurate and efficient segmentation. The application status of deep learning in spinal image segmentation is summarized and analyzed as concerns deep learning algorithms, types of spinal diseases, types of images, experimental segmentation results, and performance evaluation indicators. First, the background of the deep learning model and spinal image segmentation is described, and thereafter, the application of deep learning in spinal image segmentation is introduced. Second, several common types of spinal diseases are introduced, the difficulties in image segmentation are described, and common open datasets, image segmentation method flow, and image segmentation evaluation indicators are introduced in spinal image segmentation. Combined with specific experiments, the application progress of the Convolutional Neural Network(CNN) model, the U-Net model, and their improved models in the image segmentation of vertebrae, intervertebral discs, and spinal tumors are summarized and analyzed. Combined with previous experimental results and the current research progress of deep learning models, this paper summarizes the limitations of current clinical studies and the reasons for the insufficient segmentation effect, and proposes corresponding solutions to the existing problems. Finally, prospects for future studies and development are proposed.

Baihao JIANG , Jing LIU , Dawei QIU , Liang JIANG . Review of Deep Learning Applications in Spinal Image Segmentation[J]. Computer Engineering, 2024 , 50(3) : 1 -15 . DOI: 10.19678/j.issn.1000-3428.0067502

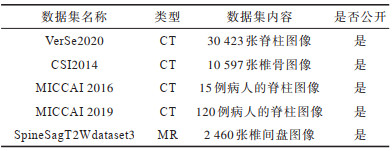

表1 数据集信息Table 1 Dataset information |

|

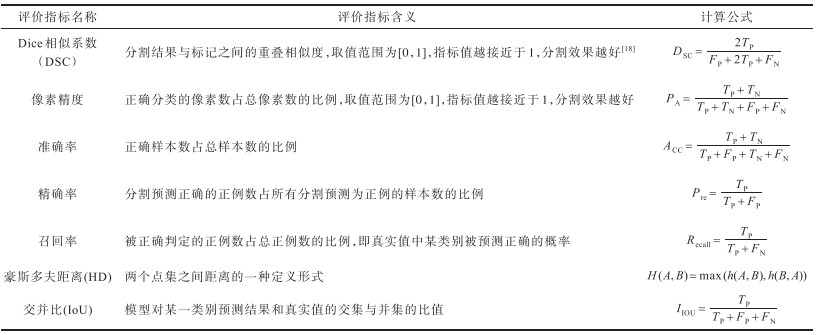

表2 图像分割评价指标Table 2 Evaluation indexes of image segmentation |

|

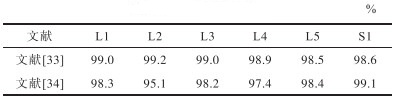

表3 特定椎骨检测精度比较Table 3 Precision comparison of specific vertebrae detection |

|

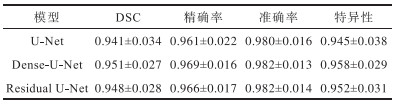

表4 不同深度神经网络模型对椎体图像的分割性能Table 4 Segmentation performance of vertebral body image by different depth neural network models |

|

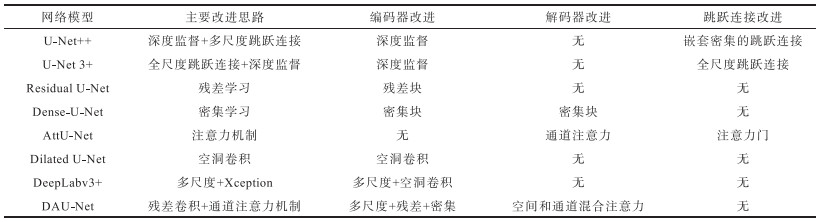

表5 U-Net模型的改进思路Table 5 Improvement ideas of U-Net model |

|

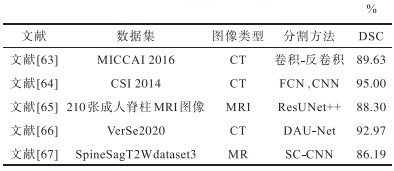

表6 国内基于深度学习对脊柱图像分割的研究Table 6 Research on spinal image segmentation based on deep learning in China |

|

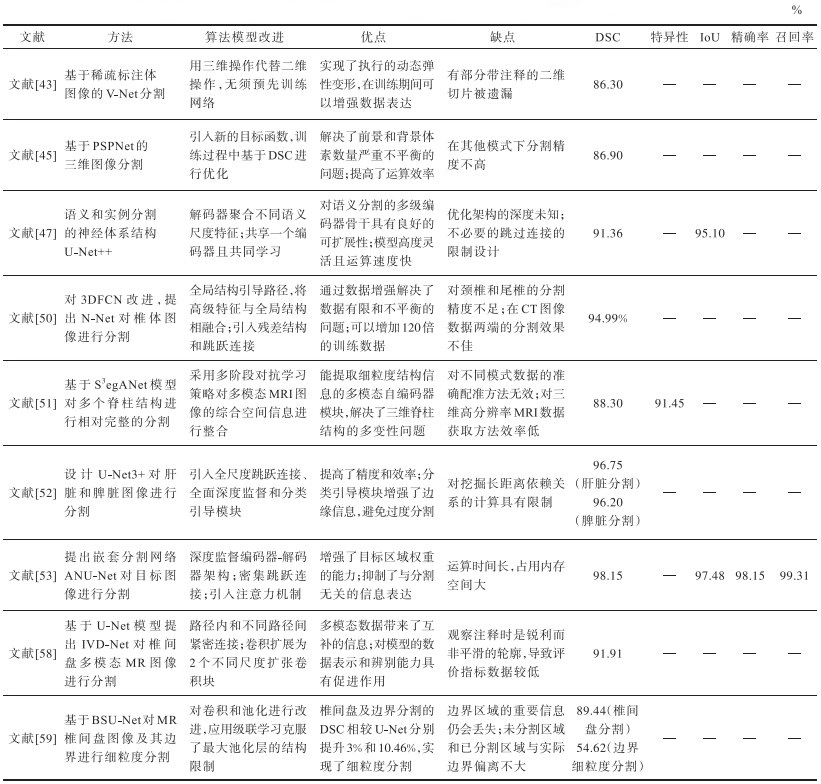

表7 不同研究中U-Net模型的图像分割性能对比分析Table 7 Comparative analysis of U-Net models' image segmentation performance in different researches |

|

| 1 |

JOSHI R S, LAU D, AMES C P. Artificial intelligence for adult spinal deformity: current state and future directions. The Spine Journal, 2021, 21(10): 1626- 1634.

|

| 2 |

杨本臣, 贾宇航, 金海波. 融合多分支特征的肝脏和肝脏肿瘤的体积分割. 计算机工程, 2023, 49(10): 194- 201.

YANG B C, JIA Y H, JIN H B. Volume segmentation of liver and liver tumor with fusion of multi-branch features. Computer Engineering, 2023, 49(10): 194- 201.

|

| 3 |

LECUN Y, BENGIO Y, HINTON G. Deep learning. Nature, 2015, 521, 436- 444.

|

| 4 |

GALBUSERA F, CASAROLI G, BASSANI T. Artificial intelligence and machine learning in spine research. JOR Spine, 2019, 2(1): e1044.

|

| 5 |

LIU X L, DENG Z D, YANG Y H. Recent progress in semantic image segmentation. Artificial Intelligence Review, 2019, 52(2): 1089- 1106.

|

| 6 |

AMES C P, SMITH J S, PELLISÉ F, et al. Artificial intelligence based hierarchical clustering of patient types and intervention categories in adult spinal deformity surgery: towards a new classification scheme that predicts quality and value. Spine, 2019, 44(13): 915- 926.

|

| 7 |

NIEMEYER F, GALBUSERA F, TAO Y P, et al. A deep learning model for the accurate and reliable classification of Disc degeneration based on MRI data. Investigative Radiology, 2021, 56(2): 78- 85.

|

| 8 |

GHOGAWALA Z, DUNBAR M, ESSA I. Artificial intelligence for the treatment of lumbar spondylolisthesis. Neurosurgery Clinics of North America, 2019, 30(3): 383- 389.

|

| 9 |

BILSKY M H, LIS E, RAIZER J, et al. The diagnosis and treatment of metastatic spinal tumor. The Oncologist, 1999, 4(6): 459- 469.

|

| 10 |

BAKAR D, TANENBAUM J E, PHAN K, et al. Decompression surgery for spinal metastases: a systematic review. Neurosurgical Focus, 2016, 41(2): E2.

|

| 11 |

BORIANI S, WEINSTEIN J N, BIAGINI R. Primary bone tumors of the spine: terminology and surgical staging. Spine, 1997, 22(9): 1036- 1044.

|

| 12 |

MESFIN A, EL DAFRAWY M H, JAIN A, et al. Total en bloc spondylectomy for primary and metastatic spine tumors. Orthopedics, 2015, 38(11): 995- 1000.

|

| 13 |

JIANG F, GRIGOREV A, RHO S, et al. Medical image semantic segmentation based on deep learning. Neural Computing and Applications, 2018, 29(5): 1257- 1265.

|

| 14 |

KAMBOJ A, GUPTA A. Simulink model based image segmentation. International Journal of Advanced Research in Computer Science and Software Engineering, 2012, 2(6): 146- 149.

|

| 15 |

WANG S D, YANG D M, RONG R C, et al. Pathology image analysis using segmentation deep learning algorithms. The American Journal of Pathology, 2019, 189(9): 1686- 1698.

|

| 16 |

ZHANG Q F, DU Y, WEI Z Q, et al. Spine medical image segmentation based on deep learning. Journal of Healthcare Engineering, 2021,(15): 1917946.

|

| 17 |

杨国亮, 赖振东, 喻丁玲. 一种改进UNet++网络用于检测黑色素瘤皮肤病变. 中国医学影像技术, 2020, 36(12): 1877- 1881.

YANG G L, LAI Z D, YU D L. An improved UNet++ network applied in detection of skin lesions in melanoma. Chinese Journal of Medical Imaging Technology, 2020, 36(12): 1877- 1881.

|

| 18 |

张欢, 刘静, 冯毅博, 等. U-Net及其在肝脏和肝脏肿瘤分割中的应用综述. 计算机工程与应用, 2022, 58(2): 1- 14.

ZHANG H, LIU J, FENG Y B, et al. Review of U-Net and its application in segmentation of liver and liver tumors. Computer Engineering and Applications, 2022, 58(2): 1- 14.

|

| 19 |

ŠAJN L, KONONENKO I, MILČINSKI M. Computerized segmentation and diagnostics of whole-body bone scintigrams. Computerized Medical Imaging and Graphics, 2007, 31(7): 531- 541.

|

| 20 |

杨兵, 刘晓芳, 张纠. 基于深度特征聚合网络的医学图像分割. 计算机工程, 2021, 47(4): 187- 196.

YANG B, LIU X F, ZHANG J. Medical image segmentation based on deep feature aggregation network. Computer Engineering, 2021, 47(4): 187- 196.

|

| 21 |

KADOURY S, LABELLE H, PARAGIOS N. Automatic inference of articulated spine models in CT images using high-order Markov random fields. Medical Image Analysis, 2011, 15(4): 426- 437.

|

| 22 |

SUZANI A, RASOULIAN A, SEITEL A, et al. Deep learning for automatic localization, identification, and segmentation of vertebral bodies in volumetric MR images[C]//Proceedings of Conference on Image-guided Procedures, Robotic Interventions, and Modeling. Orlando, USA: [s. n. ], 2015: 269-275.

|

| 23 |

LONG J, SHELHAMER E, DARRELL T. Fully convolutional networks for semantic segmentation[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Washington D. C., USA: IEEE Press, 2015: 3431-3440.

|

| 24 |

SUZANI A, SEITEL A, LIU Y, et al. Fast automatic vertebrae detection and localization in pathological CT scans—a deep learning approach[C]//Proceedings of MICCAI 2015. Berlin, Germany: Springer, 2015: 678-686.

|

| 25 |

CHEN H, SHEN C Y, QIN J, et al. Automatic localization and identification of vertebrae in spine CT via a joint learning model with deep neural networks[C]//Proceedings of MICCAI 2015. Berlin, Germany, 2015: 515-522.

|

| 26 |

HETHERINGTON J, LESSOWAY V, GUNKA V, et al. SLIDE: automatic spine level identification system using a deep convolutional neural network. International Journal of Computer Assisted Radiology and Surgery, 2017, 12(7): 1189- 1198.

|

| 27 |

VANIA M, MUREJA D, LEE D. Automatic spine segmentation using convolutional neural network via redundant generation of class labels for 3D spine modeling. Journal of Computational Design and Engineering, 2019, 6(2): 224- 232.

|

| 28 |

JANSSENS R, ZENG G D, ZHENG G Y. Fully automatic segmentation of lumbar vertebrae from CT images using cascaded 3D fully convolutional networks[C]//Proceedings of ISBI 2018. Washington D. C., USA: IEEE Press, 2018: 893-897.

|

| 29 |

LESSMANN N, VAN GINNEKEN B, IŠGUM I. Iterative convolutional neural networks for automatic vertebra identification and segmentation in CT images[EB/OL]. [2022-10-12]. https://pubmed.ncbi.nlm.nih.gov/30771712/.

|

| 30 |

CHUANG C H, LIN C Y, TSAI Y Y, et al. Efficient triple output network for vertebral segmentation and identification. IEEE Access, 2019, 7, 117978- 117985.

|

| 31 |

KOLAŘÍK M, BURGET R, UHER V, et al. Optimized high resolution 3D Dense-U-Net network for brain and spine segmentation. Applied Sciences, 2019, 9(3): 404.

|

| 32 |

SAIKUMAR K, RAJESH V, RAMYA N, et al. A deep learning process for spine and heart segmentation using pixel-based convolutional networks. Journal of International Pharmaceutical Research, 2019, 46(1): 278- 282.

|

| 33 |

ZHOU Y J, LIU Y, CHEN Q, et al. Automatic lumbar MRI detection and identification based on deep learning. Journal of Digital Imaging, 2019, 32(3): 513- 520.

|

| 34 |

CAI Y L, LANDIS M, LAIDLEY D T, et al. Multi-modal vertebrae recognition using transformed deep convolution network. Computerized Medical Imaging and Graphics, 2016, 51, 11- 19.

|

| 35 |

SURI A, JONES B C, NG G, et al. A deep learning system for automated, multi-modality 2D segmentation of vertebral bodies and intervertebral discs. Bone, 2021, 149, 115972.

|

| 36 |

符晓娟, 黄东军. 基于二维自动主动形状模型的椎间盘核磁共振图像分割算法. 计算机应用, 2013, 33(9): 2686- 2689.

FU X J, HUANG D J. Segmentation algorithm of intervertebral disc magnetic resonance images based on two-dimensional automatic active shape model. Journal of Computer Applications, 2013, 33(9): 2686- 2689.

|

| 37 |

CHEN H, DOU Q, WANG X, et al. 3D fully convolutional networks for intervertebral disc localization and segmentation[C]//Proceedings of International Conference on Medical Imaging and Augmented Reality. Berlin, Germany: Springer, 2016: 375-382.

|

| 38 |

LI X M, DOU Q, CHEN H, et al. 3D multi-scale FCN with random modality voxel dropout learning for intervertebral disc localization and segmentation from multi-modality MR Images. Medical Image Analysis, 2018, 45, 41- 54.

|

| 39 |

VANIA M, LEE D. Intervertebral disc instance segmentation using a multistage optimization mask-RCNN(MOM-RCNN). Journal of Computational Design and Engineering, 2021, 8(4): 1023- 1036.

|

| 40 |

RONNEBERGER O, FISCHER P, BROX T. U-Net: convolutional networks for biomedical image segmentation[C]//Proceedings of International Conference on Medical Image Computing and Computer-Assisted Intervention. Berlin, Germany: Springer, 2015: 234-241.

|

| 41 |

DONG H, YANG G, LIU F D, et al. Automatic brain tumor detection and segmentation using U-Net based fully convolutional networks[C]//Proceedings of Annual Conference on Medical Image Understanding and Analysis. Berlin, Germany: Springer, 2017: 506-517.

|

| 42 |

ÇIÇEK Ö, ABDULKADIR A, LIENKAMP S S, et al. 3D U-Net: learning dense volumetric segmentation from sparse annotation[C]//Proceedings of International Conference on Medical Image Computing and Computer-Assisted Intervention. Berlin, Germany: Springer, 2016: 424-432.

|

| 43 |

MILLETARI F, NAVAB N, AHMADI S A. V-Net: fully convolutional neural networks for volumetric medical image segmentation[C]//Proceedings of the 4th International Conference on 3D Vision. Washington D. C., USA: IEEE Press, 2016: 565-571.

|

| 44 |

ZHAO H S, SHI J P, QI X J, et al. Pyramid scene parsing network[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Washington D. C., USA: IEEE Press, 2017: 6230-6239.

|

| 45 |

JEGOU S, DROZDZAL M, VAZQUEZ D, et al. The one hundred layers tiramisu: fully convolutional DenseNets for semantic segmentation[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Washington D. C., USA: IEEE Press, 2017: 11-19.

|

| 46 |

OKTAY O, SCHLEMPER J, LE FOLGOC L, et al. Attention U-Net: learning where to look for the pancreas[EB/OL]. [2022-10-12]. https://arxiv.org/pdf/1804.03999.pdf.

|

| 47 |

ZHOU Z W, SIDDIQUEE M M R, TAJBAKHSH N, et al. UNet++: redesigning skip connections to exploit multiscale features in image segmentation. IEEE Transactions on Medical Imaging, 2020, 39(6): 1856- 1867.

|

| 48 |

HORNG M H, KUOK C P, FU M J, et al. Cobb angle measurement of spine from X-ray images using convolutional neural network. Computational and Mathematical Methods in Medicine, 2019, 2019, 6357171.

|

| 49 |

TAN Z Q, YANG K, SUN Y, et al. An automatic scoliosis diagnosis and measurement system based on deep learning[C]//Proceedings of IEEE International Conference on Robotics and Biomimetics. Washington D. C., USA: IEEE Press, 2018: 439-443.

|

| 50 |

ZHOU W H, LIN L L, GE G T. N-Net: 3D fully convolution network-based vertebrae segmentation from CT spinal images. International Journal of Pattern Recognition and Artificial Intelligence, 2019, 33(6): 1957003.

|

| 51 |

LI T Y, WEI B Z, CONG J Y, et al. S3egANet: 3D spinal structures segmentation via adversarial nets. IEEE Access, 2020, 8, 1892- 1901.

|

| 52 |

HUANG H M, LIN L F, TONG R F, et al. UNet 3+: a full-scale connected UNet for medical image segmentation[C]//Proceedings of ICASSP 2020. Washington D. C., USA: IEEE Press, 2020: 1055-1059.

|

| 53 |

LI C, TAN Y S, CHEN W, et al. ANU-Net: attention-based nested U-Net to exploit full resolution features for medical image segmentation. Computers & Graphics, 2020, 90, 11- 20.

|

| 54 |

王红, 史金钏, 张志伟. 基于注意力机制的LSTM的语义关系抽取. 计算机应用研究, 2018, 35(5): 1417-1420, 1440.

WANG H, SHI J C, ZHANG Z W. Text semantic relation extraction of LSTM based on attention mechanism. Application Research of Computers, 2018, 35(5): 1417-1420, 1440.

|

| 55 |

KIM Y J, GANBOLD B, KIM K G. Web-based spine segmentation using deep learning in computed tomography images. Healthcare Informatics Research, 2020, 26(1): 61- 67.

|

| 56 |

LIANG S F, LIU H L, CHEN C, et al. Research on multi-path dense networks for MRI spinal segmentation. PLoS One, 2021, 16(3): e0248303.

|

| 57 |

CAI Y T, WANG Y. MA-UNet: an improved version of Unet based on multi-scale and attention mechanism for medical image segmentation[C]//Proceedings of the 3rd International Conference on Electronics and Communication; Network and Computer Technology. Washington D. C., USA: IEEE Press, 2022: 205-211.

|

| 58 |

DOLZ J, DESROSIERS C, BEN AYED I. IVD-Net: intervertebral disc localization and segmentation in MRI with a multi-modal UNet[C]//Proceedings of International Workshop and Challenge on Computational Methods and Clinical Applications for Spine Imaging. Berlin, Germany: Springer, 2019: 130-143.

|

| 59 |

KIM S, BAE W C, MASUDA K, et al. Fine-grain segmentation of the intervertebral discs from MR spine images using deep convolutional neural networks: BSU-net. Applied Sciences, 2018, 8(9): 1656.

|

| 60 |

皮安琪. MR腰椎图像椎间盘定位与分割算法研究[D]. 西安: 陕西师范大学, 2020.

PI A Q. Study on intervertebral disc localization and segmentation algorithm in MR lumbar spine images[D]. Xi'an: Shaanxi Normal University, 2020. (in Chinese)

|

| 61 |

HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Washington D. C., USA: IEEE Press, 2016: 770-778.

|

| 62 |

CHENG Y K, LIN C L, HUANG Y C, et al. Automatic segmentation of specific intervertebral discs through a two-stage MultiResUNet model. Journal of Clinical Medicine, 2021, 10(20): 4760.

|

| 63 |

刘忠利, 陈光, 单志勇, 等. 基于深度学习的脊柱CT图像分割. 计算机应用与软件, 2018, 35(10): 200-204, 273.

LIU Z L, CHEN G, SHAN Z Y, et al. Segmentation of spine CT image based on deep learning. Computer Applications and Software, 2018, 35(10): 200-204, 273.

|

| 64 |

刘晓. 基于级联卷积神经网络的椎骨CT图像分割算法研究[D]. 哈尔滨: 哈尔滨理工大学, 2019.

LIU X. Research on CT image segmentation algorithm based on concatenated convolutional neural network[D]. Harbin: Harbin University of Science and Technology, 2019. (in Chinese)

|

| 65 |

周瑞文. 基于卷积神经网络的脊柱MRI图像分割算法研究[D]. 武汉: 中南民族大学, 2021.

ZHOU R W. Research on spinal MRI image segmentation algorithm based on convolutional neural network[D]. Wuhan: South-Central University for Nationalities, 2021. (in Chinese)

|

| 66 |

张辰翰. 基于深度学习的脊柱CT图像分割[D]. 成都: 电子科技大学, 2021.

ZHANG C H. Research on CT image segmentation of spine based on deep learning[D]. Chengdu: University of Electronic Science and Technology of China, 2021. (in Chinese)

|

| 67 |

于文涛, 张俊华, 梅建华, 等. 脊柱MR图像自动分割方法的研究. 计算机工程与应用, 2022, 58(22): 203- 209.

YU W T, ZHANG J H, MEI J H, et al. Research on automatic segmentation method of spinal MR images. Computer Engineering and Applications, 2022, 58(22): 203- 209.

|

| 68 |

ROTH H R, YAO J H, LU L, et al. Detection of sclerotic spine metastases via random aggregation of deep convolutional neural network classifications[M]//YAO J, GLOCKER B, KLINDER T, et al. Recent advances in computational methods and clinical applications for spine imaging. Berlin, Germany: Springer, 2015: 3-12.

|

| 69 |

WANG J, FANG Z Y, LANG N, et al. A multi-resolution approach for spinal metastasis detection using deep Siamese neural networks. Computers in Biology and Medicine, 2017, 84, 137- 146.

|

| 70 |

CHMELIK J, JAKUBICEK R, WALEK P, et al. Deep convolutional neural network-based segmentation and classification of difficult to define metastatic spinal lesions in 3D CT data. Medical Image Analysis, 2018, 49, 76- 88.

|

| 71 |

LI Y, PING W. Cancer metastasis detection with neural conditional random field[EB/OL]. [2022-10-12]. https://arxiv.org/abs/1806.07064.

|

| 72 |

SHAO Q B, GONG L J, MA K, et al. Attentive CT lesion detection using deep pyramid inference with multi-scale booster[C]//Proceedings of International Conference on Medical Image Computing and Computer-Assisted Intervention. Berlin, Germany: Springer, 2019: 301-309.

|

| 73 |

LIN T Y, DOLLAR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Washington D. C., USA: IEEE Press, 2017: 2117-2125.

|

| 74 |

REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137- 1149.

|

| 75 |

YAN K, BAGHERI M, SUMMERS R M. 3D context enhanced region-based convolutional neural network for end-to-end lesion detection[C]//Proceedings of International Conference on Medical Image Computing and Computer-Assisted Intervention. Berlin, Germany: Springer, 2018: 511-519.

|

| 76 |

LANG N, ZHANG Y, ZHANG E L, et al. Differentiation of spinal metastases originated from lung and other cancers using radiomics and deep learning based on DCE-MRI. Magnetic Resonance Imaging, 2019, 64, 4- 12.

|

| 77 |

苗燕茹. 基于深度学习的脊柱肿瘤CT图像修复方法研究[D]. 深圳: 中国科学院大学中国科学院深圳先进技术研究院, 2020.

MIAO Y R. Spinal neoplasm image inpainting based on deep learning[D]. Shenzhen: Shenzhen Institutes of Advanced Technology, Chinese Academy of Sciences, 2020. (in Chinese)

|

| 78 |

CHIANCA V, CUOCOLO R, GITTO S, et al. Radiomic machine learning classifiers in spine bone tumors: a multi-software, multi-scanner study. European Journal of Radiology, 2021, 137, 109586.

|

| 79 |

ARENDS S R S, SAVENIJE M H F, EPPINGA W S C, et al. Clinical utility of convolutional neural networks for treatment planning in radiotherapy for spinal metastases. Physics and Imaging in Radiation Oncology, 2022, 21, 42- 47.

|

/

| 〈 |

|

〉 |